よこぼと申します。

超初心者です🔰

同じような初心者・初学者の方にも、

育成や普及活動を進める立場の方にも、

参考になるような記事をあげていけたらと思います。

よろしくお願いします🙇

=======================

最初は関係ない話をします。

(というか前半書きたいことを書いて後半はおまけです)

CDLEってAIのことDLのことを勉強する人にとって、

モチベーションを与える場所だと思うんです。

みなさん素晴らしい記事を書いてくださっていて、

読むだけでとても勉強になります。

そんな中、僕がこのような記事を書こうと思ったのは

自分にできるやり方でCDLEに貢献したいと思ったからです。

・もしかしたら同じような初心者がいるけどなかなか発言できないだけかもしれない

・育成に悩んでいる指導者の方がいるかもしれない

・最近勉強することの楽しさを忘れているかも・・・?という方がいるかもしれない

そんなみなさんが、

「こんな低レベル(笑)でブログ書いていいんだ!自分も頑張ろう」

「なるほど初心者はこんなところにひっかかるのかメモしよう」

「こいつ初心者のくせに頑張ってるな、楽しそうだな、俺も頑張ろう」

みたいに思ってくれたら、大大大成功だと思います。

・・・まあ本当の目的はブログを書くことで自分のモチベーションを維持することですけど(・ω<)

というわけで長々と書きましたが、

定期的に投稿していこうと思いますので、みなさま温かい目で見守っていただけると嬉しいです!!

こんな学び方がいいよ!みたいなコメントとかくださると泣いて喜びます😿

=======================

後半戦

まあここからはおまけみたいなものです。

最近もっぱらこの「Python3年生」で勉強しております。

とてもわかりやすい

G検定の教科書でさっぱりわからなかったことが、

ちょっとわかってきた気がする。

やっぱり実際に手を動かしてみないとわからないですよね。

Google Colabを使用して、

XORやってみたりMNISTの手書き数字を読んでみたりしました。

先日やったのは、CNNでCIFAR-10(画像集)の学習をしてみよう、というもの。

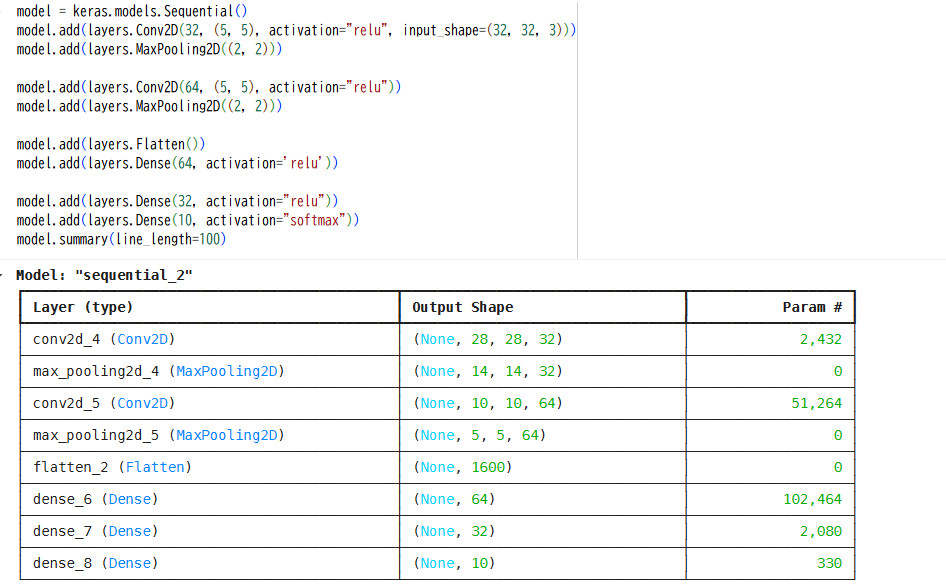

まずこんな感じのモデルをつくりました。

畳み込み層(Conv2D)があって、MaxPoolingがあって。。。。的なやつ。

#実際には本で紹介されていたモデルから3か所自分で抜いて実験してみたやつです

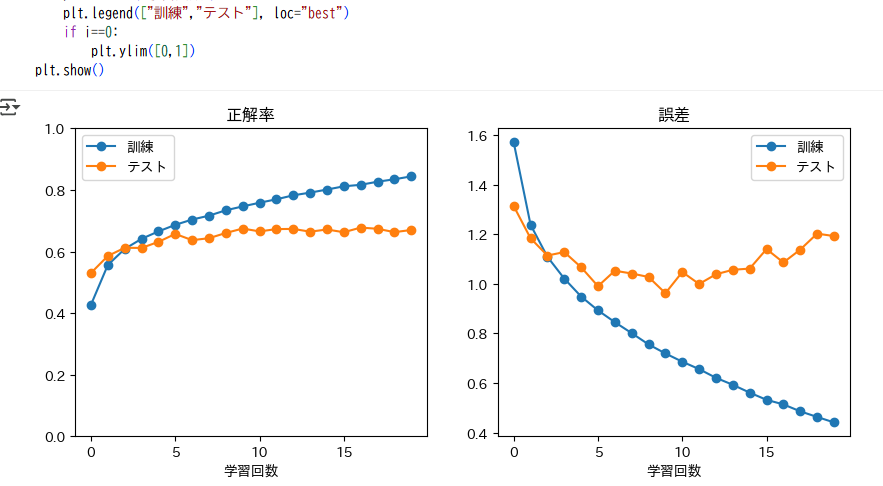

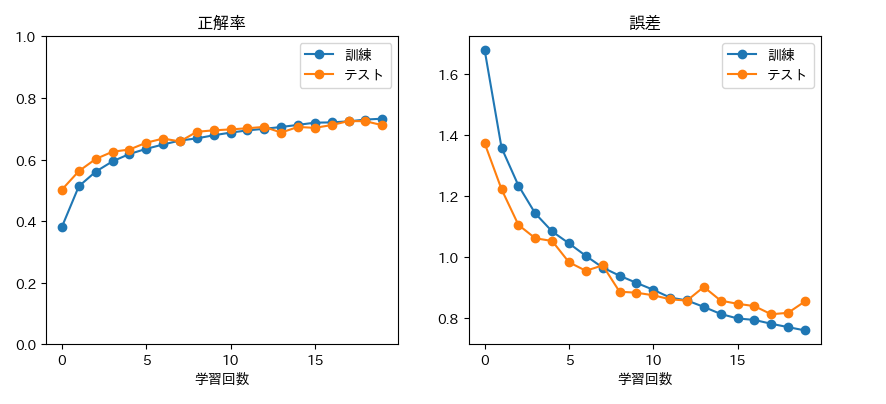

訓練・テストのプロット

⇒なるほど、誤差が学習回数増やしても下がらなくなっている

⇒過学習というやつですね!

これが!!!あの有名な過学習(オーバーフィッティング)か!!

とちょっと感動しました。

#関係ないけどオーバーフィッティングという響きがなんか好きです

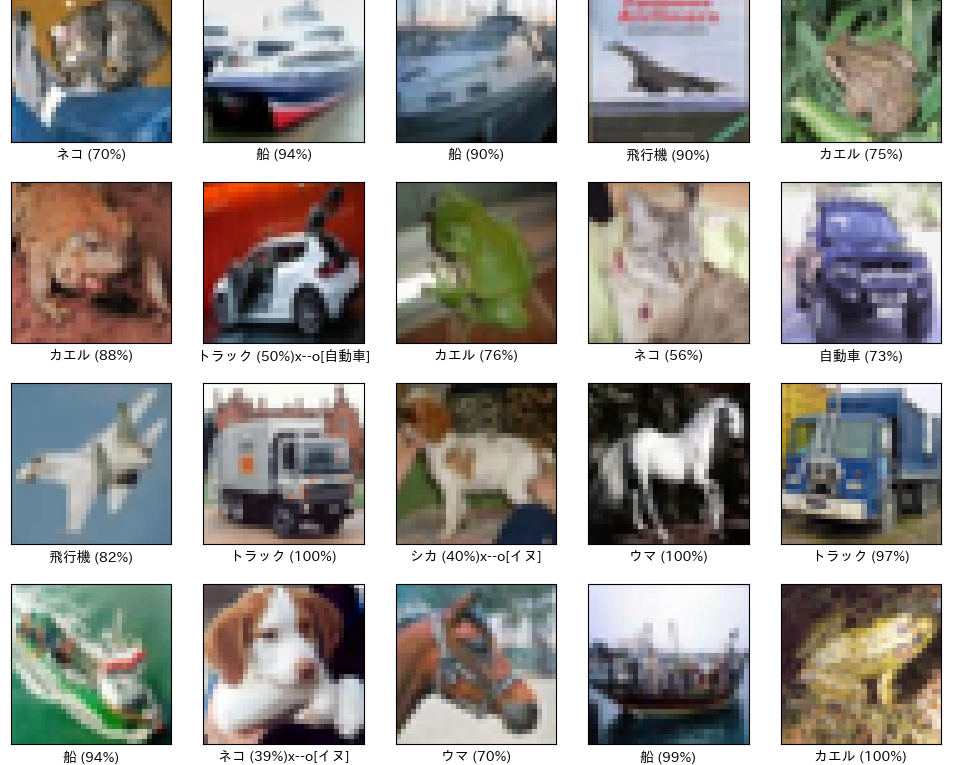

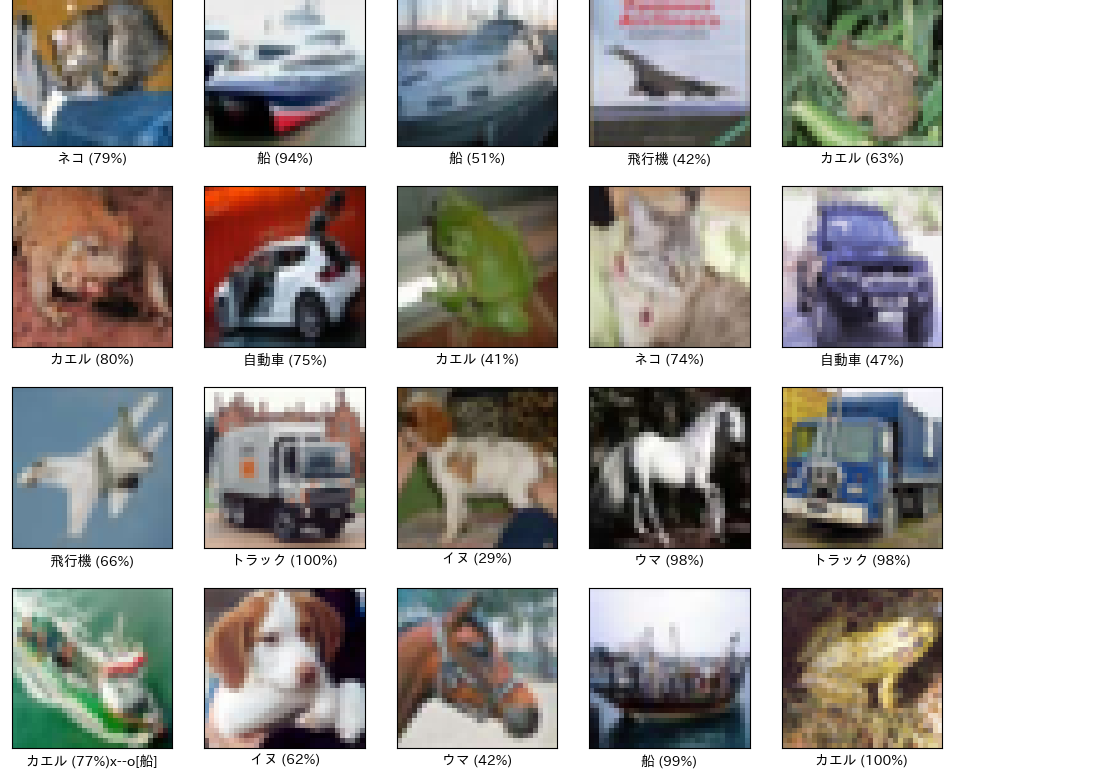

いや、でも結構がんばってるんですよね。

ネコ・・・・(39%) とか自信なさげでかわいい。イヌだったね。

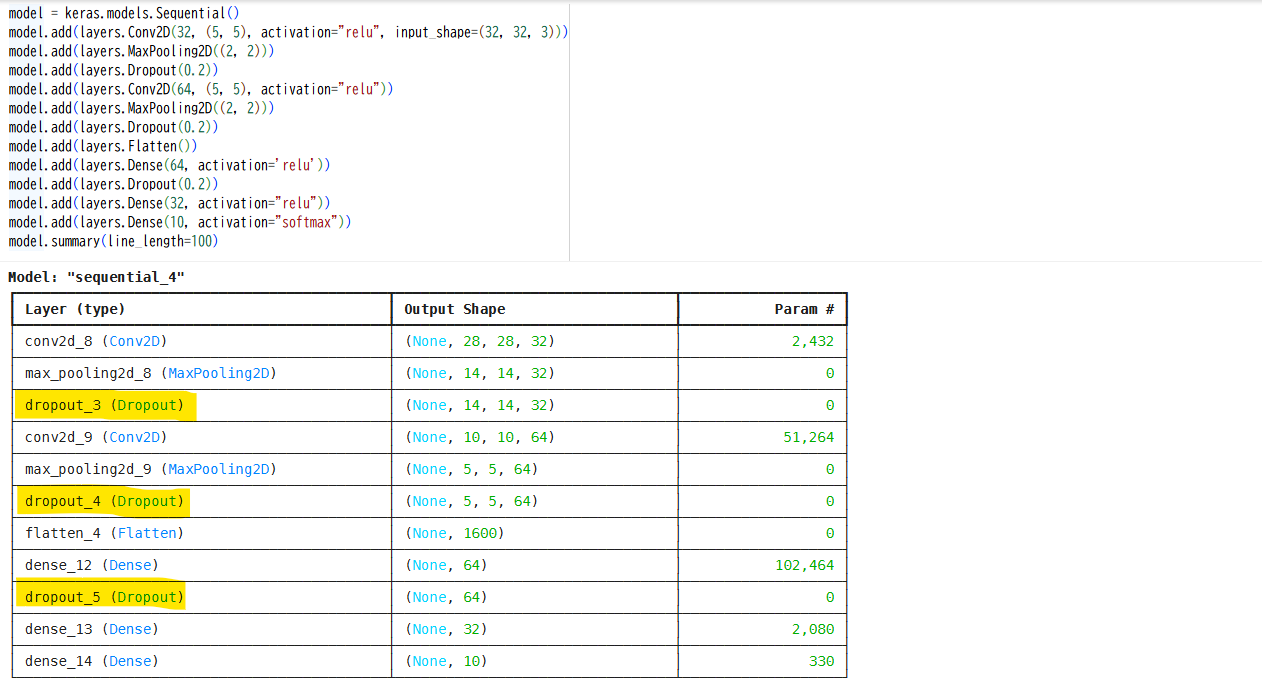

じゃあ過学習を抑えてみよう、ということでこいつを入れます。

ゆけ!!!!ドロップアウト!!!!!

さあ・・・結果は??

おおー、誤差が学習回数に応じて下がっていますね!

これがドロップアウトの力か・・・!!!

でも結果としては正解率下がっているんですよね。。。

カエル(77%)!!!とか言ってるし。。。(船だよ、なんで自信満々なんだよ)

と思ったら、これがドロップアウトの副作用「訓練精度の低下」ってやつなんですね。

なるほど、やっぱり自分でやってみるっていっぱい学べる!!

以上、今回のテーマ「過学習とドロップアウト」でしたー。

お読みいただきありがとうございました🙇♂️

また次回!

#どうでもいい話ですが、トップ画像はVGG16というモデルにかの有名な画像を判定してもらった結果です。カニって学習データになかったんかな。。。

2025/09/21 00:00

超初心者🔰の勉強のじかん①(ドロップアウトと過学習)

16リアクション

このブログ一覧は

メンバー投稿記事

ですメンバー登録すると、限定記事の閲覧やメンバー同士の交流、限定イベントへの参加などができます。

CDLEコミュニティサイトβ版

JDLA(一般社団法人日本ディープラーニング協会)が実施する、G検定・E資格の合格者のみが参加できる、10万人を超える日本最大級のAIコミュニティ「CDLE」の紹介サイトです。 CDLEでは、ディープラーニングの社会実装の日本代表として、社会を発展させるエバンジェリストたちが集まり、学び合い・アウトプットする場を提供しています。

詳細を見るCDLEメンバー

¥55/月(税込)

登録情報を確認の上、事前登録された方へ本登録のご案内メールを送信します。もっとみる閉じる

登録情報を確認の上、事前登録された方へ本登録のご案内メールを送信します。

16リアクション

メンバーの方はこちらからログイン